iOS 10.1 的人像模式可以看成單眼相機的人像鏡拍攝功能,利用特定焦距與軟體運算模擬景深效果,進而拍出更能強調主體的照片,不過由於相機鏡頭的關係,目前僅會在搭載望遠鏡頭的 iPhone 7 Plus 上使用,尚在 beta 階段的軟體也有一些地方需要再後續更新調整,整體來說成像還不錯,而且拍照操作快速敏捷,以下拍攝心得提供給大家參考。

人像模式跟人有什麼關係?

提到人像模式更多人對它的理解是景深相機,其實這兩種說法都對,差別在於景深是對成像效果的描述,人像模式則跟相機軟硬體結合有關。

在單眼相機的世界中,我們會將 50mm/f1.8 的定焦鏡稱之為「人像鏡」,因為大光圈能營造出朦朧的景深效果,透過這個特性,拍照時只要將對焦點對準人像,背後的景色就會因為景深而被虛化,進而做到凸顯人像的效果,而 Apple 的人像模式則是利用 iPhone 7 Plus 特有的 57mm 長焦鏡頭來做為人像模式的拍攝鏡頭。

另一方面,在人像模式下相機會自動辨識人像調整對焦,按下快門前如果物體有移動也會持續追蹤並調整到正確焦距,與一般模式差別在於一般模式只自動偵測臉部範圍,人像模式則是偵測整個人像進行曝光與焦距調整。

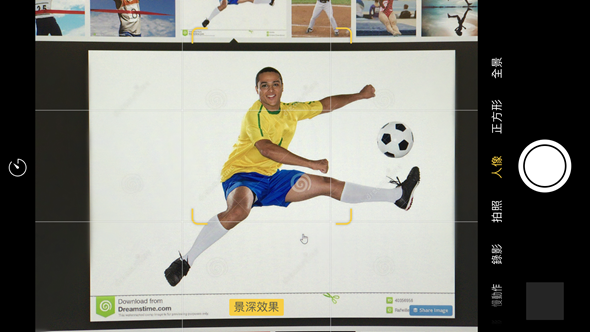

▲ 一般模式:臉部偵測。

▲ 景深模式:人像大面積偵測。

iPhone 7 Plus 人像模式的處理方式

即使 iPhone 7 Plus 具備 57mm 的長焦鏡頭,但受限於手機感光元件尺寸較小,原理上無法做到跟單眼鏡頭相似的景深效果,必須借助軟體調整才能加強虛化。

為什麼是加強呢?只要被攝物與相機之間的距離不同,在照片上就會呈現清晰與模糊的部分,任何鏡頭都會產生類似的效果,差別在於景深的深與淺,iPhone 會透過軟體分析畫面影像,再根據模糊的強弱來加強畫面虛化的效果,如此一來就能達到更大的景深效果。

下面這張照片就是一般拍照和景深效果的差異,對焦點在貓的頭部,以人像模式拍攝後,身體後半部與沙發都被虛化了。

使用人像模式的方法與限制

人像模式在相機畫面左右滑動就可切換,但在這個模式下 iPhone 7 Plus 只會使用 57mm 望遠鏡頭拍照,因此必須遠離被攝物一段距離才能捕捉畫面,相機會自動偵測畫面內容並且提醒你距離主體 2.5 公尺以內,不過距離僅供參考,在拍攝非人像的主體時 iPhone 無法正確判斷主體的完整度,所以就算退到可以拍攝的距離,畫面上仍可能出現要你移動距離的提示,通常除非太近,否則上下移動一下畫面就可。必須注意的是,只有畫面中亮起黃色的「景深效果」的字才能讓 iPhone 進行畫面虛化效果模擬。

另外,由於 57mm 望遠鏡頭的光圈只有 f2.8,進光量相較另一個鏡頭小很多,加上景深模式下 LED 補光燈無法使用,所以在光線不夠的地方景深模式幾乎無法正常運作,必須額外補光或移動到亮處才行,就算勉強拍照成功照片也會有高 ISO 產生的明顯雜訊,iPhone 在這部分似乎沒有重新對照片做處理處理。

那麼前置鏡頭的人像模式怎麼樣?很可惜的,前相機並沒有人像功能,但是當你切換到前相機時各種模式選項還顯示在畫面上,這是 iOS 相機 UI 設計的小問題,只要你切換到人像或慢動作模式時,鏡頭會自動轉至機身背後的鏡頭,以 iOS 過去的設計來看,這個現象已經可以撐上是”問題”了。

接下來分享一些人像模式拍攝的照片

邊緣處理偶有瑕疵出現

既然是透過軟體處理難免會碰到辨識錯誤的狀況,譬如下圖紅框處原本應該是平滑的蓋子,但由於軟體處理上的問題導致產生波浪狀的變形。類似狀況只會發生在物體的邊緣,出現機率不高,硬大拍攝數十組照片也只有這張出現此狀況,而且現在人像模式還在 Beta 階段,未來更新後應該就可更準確的判斷。

雖非獨家功能但也做得不錯

iPhone 7 Plus 並不是第一個內建景深相機的手機,HTC 早在 2014 年的 M8 就有 Duo Camera 利用雙鏡頭做出景深效果,同樣都是透過硬體資訊搭配軟體後製照片的景深,iPhone 只能算是第一次使用。有了前車之鑑當然不能再犯其他廠商曾經修正過的bug,因此目前 beta 階段的人像模式基本上已經有不錯的表現。

從另一個面向來看,Apple 習慣在透過功能限制降低使用者碰到不會操作的可能,環境亮度和距離就是人像模式的限制,很顯然的,目前的設計並沒有最佳化,距離判斷時常會讓景深功能一秒開關兩三次,亮度不足拍攝出來的照片噪訊過於明顯,期待未來更新後能有所改善。